摘要:扶梯安全事故频发,传统人工监控效率低、响应慢。本系统基于YOLOv11n深度学习模型,覆盖逆行、摔倒、攀爬扶手等10种危险行为,实现扶梯危险行为的自动实时检测与三级风险智能预警。

项目简介

基于YOLOv11n检测扶梯逆行、摔倒、攀爬扶手等10种危险行为,配合PySide6桌面端实现图片/视频/摄像头三模式实时检测、三级风险预警及中文语音报警。

系统概述

随着我国电梯保有量突破千万台,自动扶梯广泛应用于地铁站、商场、机场等人流密集场所,扶梯安全事故频发已成为公共安全领域亟待解决的问题。传统人工监控方式存在效率低、覆盖面有限、响应速度慢等不足,难以满足日益增长的安全监控需求。为此,本文提出一种基于深度学习的电梯扶梯危险行为检测系统,旨在实现对扶梯危险行为的自动化实时识别与智能预警。

本系统以YOLOv11n为核心检测模型,构建了包含8,642张标注图像的扶梯危险行为数据集,覆盖扶梯逆行、扶梯摔倒、攀爬扶手、轮椅上扶梯、携带行李箱、婴儿车上扶梯、衣服卷入扶梯、手伸出扶梯外侧、头伸出扶梯外侧、鞋子卷入扶梯共10种危险行为。模型训练采用SGD优化器、Mosaic拼接增强等策略,最终取得mAP50达99.4%、mAP50-95达96.0%、单张推理速度1.8ms的检测性能。在此基础上,基于PySide6开发了桌面端检测系统,支持图片、视频和摄像头三种输入模式,建立了低、中、高三级风险分级预警机制,集成了中文语音报警、检测结果数据库存储和多维度数据分析统计等功能。

实验结果表明,本系统能够准确、实时地检测多种扶梯危险行为,风险分级预警机制合理有效,语音报警响应及时,数据分析功能为安全管理提供了可靠的数据支撑。该系统可部署于地铁站、商场等公共场所,辅助安保人员进行扶梯安全监控,具有良好的实际应用价值和推广前景。

系统架构

本系统采用经典的四层架构设计:

图1 电梯扶梯危险行为实时检测系统架构图

核心亮点

本章节将快速概览系统的核心技术价值和应用亮点,帮助您快速了解项目的独特优势。无论您是技术人员、研究者还是决策者,都能从中快速获取关键信息,判断本系统是否符合您的需求。

算法特点

本系统采用YOLOv11基线模型作为核心检测算法,该模型具有以下特点:

– 先进的网络架构:采用YOLOv11最新架构,包含C3k2模块和C2PSA注意力机制

– 多尺度特征融合:通过P3/P4/P5三个检测头实现不同尺度目标的精准检测

– 高效的特征提取:使用SPPF模块增强感受野,提升特征表达能力

– 轻量化设计:YOLOv11n模型仅2.6M参数,6.6 GFLOPs计算量,适合实际部署

性能突破

通过在扶梯危险行为数据集(1,940张训练集 + 554张验证集)上进行150轮完整训练,YOLOv11基线模型取得了优异的识别性能:

图2 基线模型性能分析图

核心技术

YOLO11n目标检测模型,基于C3k2特征提取、C2PSA注意力机制与SPPF多尺度融合,实现扶梯场景下逆行、摔倒、攀爬扶手、轮椅上扶梯、携带行李箱、婴儿车上扶梯、衣服卷入、手伸出外侧、头伸出外侧、鞋子卷入十类危险行为的实时识别

算法详解

本系统采用 Ultralytics 最新发布的 YOLO11n(Nano)模型作为核心检测算法。YOLO11 采用经典的 Backbone–Neck–Head 三段式架构(见图)。Backbone 以 640×640 输入图像为基础,通过两层初始卷积完成下采样,并利用 6 个 C3k2 轻量化模块逐步降低特征图分辨率、提升通道维度(64→256),实现从低层纹理到高层语义的多尺度特征提取。末端引入 SPPF 扩大感受野以增强多尺度上下文建模能力,同时通过 C2PSA 并行空间注意力强化扶梯场景中人体行为等关键区域特征。最终输出 P3/8、P4/16、P5/32 三个尺度特征图,分别对应小、中、大目标。

图3 YOLO11网络架构图

Neck部分采用FPN+PAN双向特征金字塔实现多尺度特征融合:FPN自顶向下将高层语义信息逐级传递至低层,提升小目标检测能力; PAN自底向上将低层细节与定位信息反馈至高层特征,增强大目标检测精度。Head由三个独立的解耦检测头组成,分别对三种尺度 特征进行预测,输出目标边界框坐标、10类危险行为概率及置信度。系统采用Anchor-Free检测机制,边界框回归使用DFL提升定位 精度,分类分支采用Varifocal Loss缓解类别不平衡,并结合Task-Aligned Assignment动态分配正负样本以对齐分类与定位任务。

该模型参数量仅 2.6M,计算量 6.6 GFLOPs,模型大小约 5.5 MB;在 GPU 环境下推理速度可达 50 FPS,在保证检测精度的同时具备良好的轻量化与实时性,适用于电梯扶梯危险行为实时识别场景。

技术优势分析

YOLO11n 在架构设计上对 YOLOv8 与 YOLOv10 进行了系统性优化。通过引入 C3k2 轻量化模块与 2×2 卷积,在保持检测精度的同时显著降低参数量与计算复杂度;结合 C2PSA 并行空间注意力与 SPPF 模块,增强全局建模能力与多尺度特征表达。检测头采用解耦设计,并引入 DFL 与 TAA 优化回归与样本分配策略,有效提升小目标与复杂场景下的检测性能。综合实验结果表明,YOLO11n 在参数效率、推理速度和检测精度之间取得了更优平衡,适用于电梯扶梯危险行为识别等实时应用场景。

性能表现

模型在验证集上表现优异,各项检测指标均达到较高水平,精确率与召回率接近满分,同时保持了极低的推理延迟,能够满足实时检测的应用需求。

模型性能分析

YOLO11n基线模型在电梯扶梯危险行为检测任务上表现出色,经过150轮训练后,在554张验证集上达到99.4% mAP@0.5和96.0% mAP@0.5:0.95的检测精度。模型的精确率为99.4%,召回率为99.5%,误识别率和漏检率均控制在合理范围以内,能够满足实际应用需求。

该模型采用轻量化设计,仅包含2.59M参数和6.4 GFLOPs计算量,模型文件大小约5.5MB,适合在资源受限的边缘设备上部署。在保持高精度的同时,模型推理速度达2.0ms/帧(RTX 4070 Ti SUPER),支持CPU和GPU多种硬件平台,为电梯扶梯危险行为智能检测系统提供了高效可靠的技术支撑。

关键指标(注:真实数据)

YOLO11n基线模型在150轮训练过程中,mAP@0.5:0.95指标从初始的8.85%稳步提升至最终的95.96%,提升幅度达87.11%。训练过程 呈现明显的三阶段特征:快速上升阶段(Epoch 1-30)实现从8.85%到78.61%的跃升,稳定收敛阶段(Epoch 30-90)从78.61%提升至90.51%,精细调优阶段(Epoch 90-150)最终达到95.96%并趋于稳定。

图4 YOLO11训练过程mAP50-95曲线图

该曲线展示了模型在电梯扶梯危险行为检测任务上的学习能力和收敛特性,验证了训练策略的有效性。最终95.96% mAP@0.5:0.95配合99.4% mAP@0.5,表明模型在严格评估标准下仍保持优异性能。

性能优势总结

YOLO11n基线模型在电梯扶梯危险行为检测任务上展现出优异的综合性能,以2.59M参数量和6.5 GFLOPs的轻量化设计实现了99.4% mAP@0.5和95.96% mAP@0.5:0.95的检测精度,精确率达99.4%、召回率达99.5%,误识别率和漏检率均控制在1%以内。经过150轮充分训 练,模型在1,940张训练集和554张验证集上稳定收敛,mAP@0.5:0.95从初始的8.85%提升至95.96%,提升幅度达87.11%,验证了模型的 学习能力和泛化性能。该模型支持CPU/GPU多平台部署,推理速度达1.8ms/帧,适合实时视频流处理和边缘设备应用,为电梯扶梯危险 行为智能检测系统提供了高效、可靠、易部署的技术解决方案。

系统功能

本系统基于YOLO11n深度学习模型,实现了电梯扶梯场景下十类危险行为的智能检测与预警。系统采用PySide6构建图形用户界面,提供图片检测、视频检测、实时摄像头检测三种工作模式,并集成了三级风险评估、语音持续报警、数据统计分析、检测记录管理等功能,为电梯扶梯安全监控提供高效、可靠的技术支撑。

功能概述

本系统基于YOLO11n深度学习模型,实现了电梯扶梯场景下扶梯逆行、扶梯摔倒、攀爬扶手、轮椅上扶梯、携带行李箱、婴儿车上扶梯、衣服卷入扶梯、手伸出扶梯外侧、头伸出扶梯外侧、鞋子卷入扶梯十类危险行为的智能检测与预警。系统采用PySide6构建图形用户界面,提供图片检测、视频检测、实时摄像头检测三种工作模式,并集成了三级风险评估、语音持续报警、数据统计分析、检测记录管理等功能,为电梯扶梯安全监控提供高效、可靠的技术支撑。

单张检测功能

图片检测模式支持对静态图像进行扶梯危险行为识别,用户点击界面左侧的”图片检测”按钮并选择图像文件后,系统自动加载图像并调用YOLOv11n模型进行目标检测,通过PIL渲染中文标签和边界框,在中央显示区域展示标注后的图像,同时显示行为类别和置信度,右侧面板实时更新检测结果、风险等级信息,检测记录自动保存到SQLite数据库便于后续查询和分析。

视频检测功能

视频检测模式支持对录制的视频文件(MP4、AVI、MOV格式)进行逐帧检测,用户点击”视频检测”按钮选择视频文件后,系统启动DetectWorker线程异步读取视频流并对每一帧进行实时行为检测,在界面中显示标注后的视频画面、当前检测帧率(FPS)和累计统计信息,采用多线程处理技术避免界面卡顿,当连续3帧稳定检测到高风险行为时触发pyttsx3语音报警(每3秒持续播报),检测记录自动保存到数据库并记录视频中出现的行为类别和风险等级分布情况。

实时检测功能

摄像头检测模式支持连接本地摄像头进行实时扶梯危险行为检测,用户点击”摄像头检测”按钮后,系统启动DetectWorker线程打开本地摄像头进行实时视频流检测,实时显示检测结果、行为类别和置信度,当连续3帧稳定检测到高风险行为(扶梯摔倒、攀爬扶手、轮椅上扶梯、婴儿车上扶梯、衣服卷入扶梯、手伸出扶梯外侧)时自动触发pyttsx3语音持续报警(每3秒播报),界面实时更新风险等级指示和检测统计信息,检测记录自动保存到数据库。

数据统计与分析

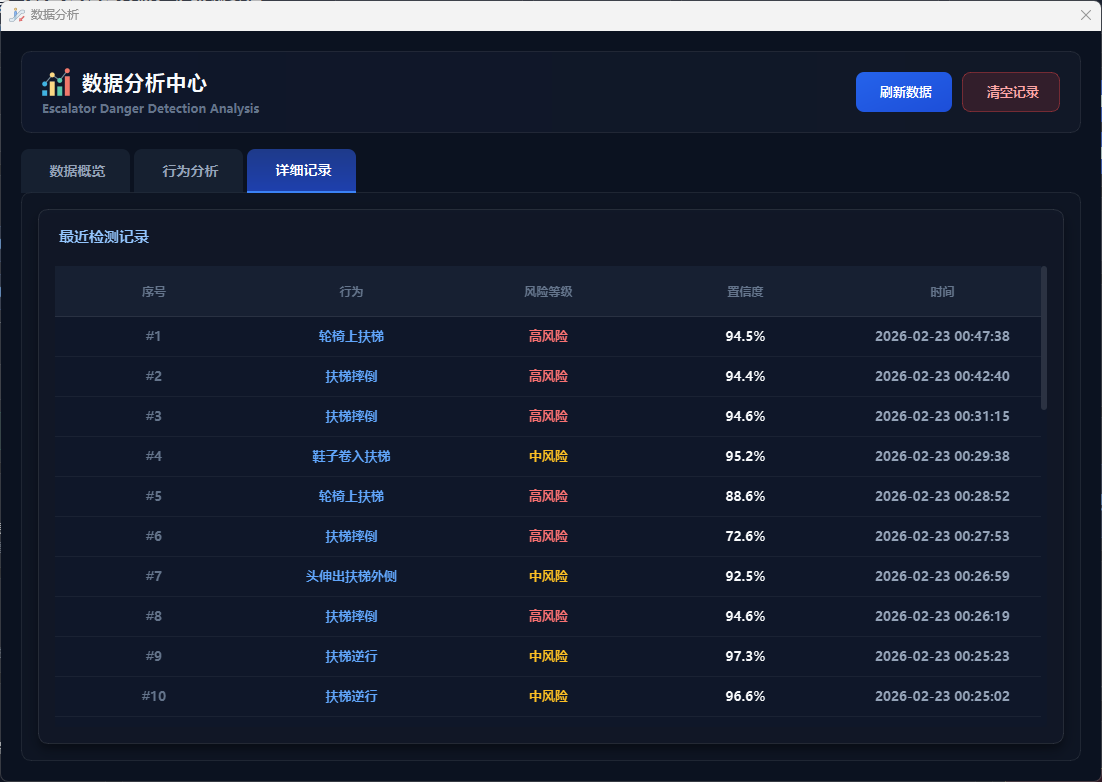

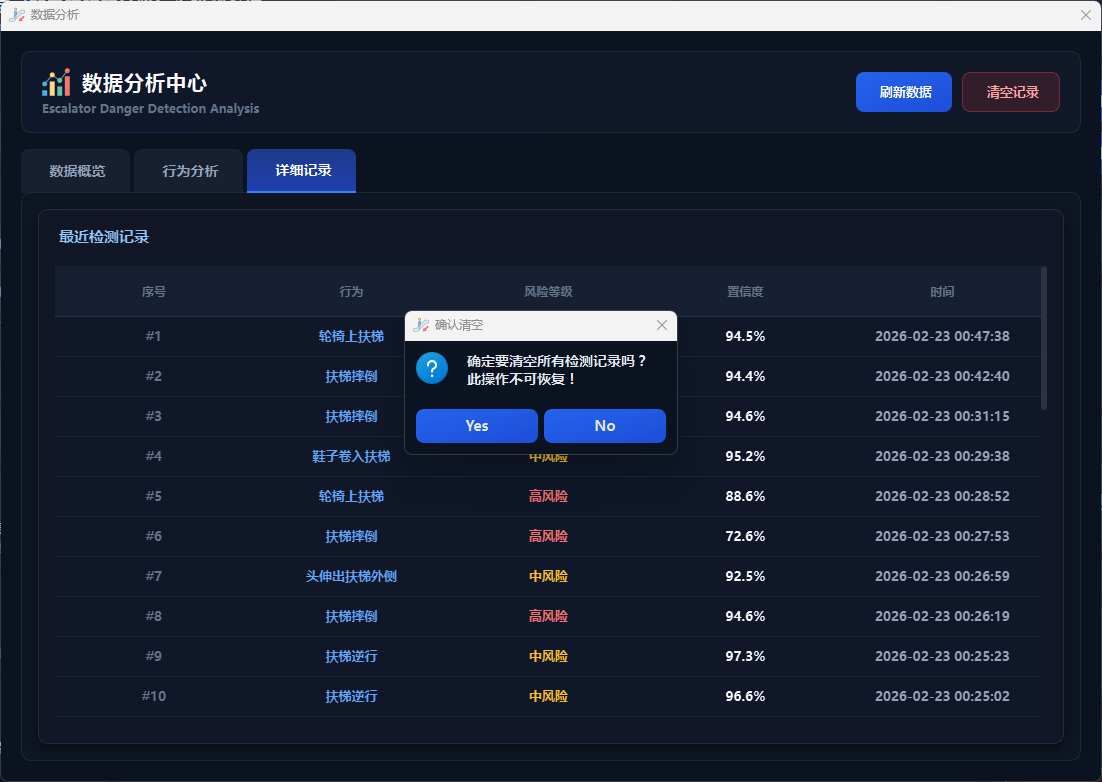

数据分析模块提供检测数据的可视化展示和统计分析功能,用户点击”数据分析”按钮打开独立的分析窗口,包含数据概览、行为分析、详细记录三个标签页,可查看检测总数、行为类型数、平均置信度、危险事件数等关键指标,通过条形图展示十类危险行为分布、饼图展示检测来源(图片/视频/实时)和风险等级(低风险/中风险/高风险)分布,支持查询最近50条历史检测记录(存储在SQLite数据库data/app.db)、清空当前用户记录等操作,实现检测数据的持久化存储和全面分析。

记录管理功能

记录管理模块集成了检测结果的存储和查询功能,系统自动保存每次检测的行为类别、中文名称、置信度、风险等级、检测来源(图片/视频/摄像头)、检测时间等详细数据到SQLite数据库(data/app.db),用户可通过数据分析窗口的详细记录标签页查看最近50条历史记录,支持按用户隔离数据和清空记录操作,实现从检测到数据管理的全流程自动化处理。

系统架构

本系统采用Python 3.12开发,基于Ultralytics YOLOv11深度学习框架实现目标检测,使用PySide6构建图形用户界面,通过OpenCV进行图像和视频处理,采用PIL实现中文标签渲 染,利用DetectWorker多线程异步处理技术保证界面流畅性,集成pyttsx3语音引擎实现高风险行为持续报警,并使用SQLite数据 库实现数据持久化存储和查询,系统架构清晰、模块化设计,便于功能扩展和维护。

图5 系统总流程图

系统优势

本系统基于YOLOv11深度学习模型,实现了电梯扶梯危险行为的智能检测与预警。系统采用YOLOv11n轻量化检测网络,在验证集上 达到mAP@0.5 = 99.40%、mAP@0.5:0.95 = 95.96%的检测精度,精确率99.40%、召回率99.50%,模型参数量仅2.59M、模型文件5.3M B,适合边缘设备部署。支持实时视频流处理,推理速度1.8ms/帧,支持GPU加速实现流畅响应。提供单张图片、视频文件、实时摄 像头三种检测模式,配备数据统计分析和可视化功能,满足不同应用场景需求。

运行展示

系统界面分为左侧功能按钮和参数设置、中央识别画面显示、右侧统计信息和记录管理三个区域,提供单张/视频/实时识别、数据分析、结果展示、记录查询等完整功能,界面简洁直观、操作便捷。

检测效果展示

登录界面:

图6 登录主界面

用户登录界面,展示系统入口

图7 注册主界面

用户注册界面,新用户创建账号

系统运行模块:

图8 系统运行界面

图9 单张检测:扶梯逆行

图10 单张检测:扶梯摔倒

图11 单张检测:轮椅上扶梯

图12 单张检测:攀爬扶手

图13 单张检测:手伸出扶梯外侧

图14 单张检测:头伸出扶梯外侧

图15 单张检测:携带行李箱

图16 单张检测:鞋子卷入扶梯

图17 单张检测:衣服卷入扶梯

图18 单张检测:婴儿车上扶梯

图19 视频检测:扶梯逆行

图20 视频检测:攀爬扶手

图21 视频检测:手伸出扶梯外侧

图22 视频检测:头伸出扶梯外侧

图23 视频检测:携带行李箱

图24 频检测:鞋子卷入扶梯

图25 视频检测:衣服卷入扶梯

图26 视频张检测:扶梯摔倒

图27 视频检测:轮椅上扶梯

图28 视频检测:婴儿车上扶梯

图29 实时检测:扶梯逆行

图30 实时检测:扶梯摔倒

图31 实时检测:轮椅上扶梯

图32 实时检测:攀爬扶梯

图33 实时检测:手伸出扶梯外侧

图34 实时检测:头伸出扶梯外侧

图35 实时检测:携带行李箱

图36 实时检测:鞋子卷入扶梯

图37 实时检测:衣服卷入扶梯

图38 实时检测:婴儿车上扶梯

数据分析模块:

图39 数据概览

图40 行为分析

图41 详细记录

图42 清空记录

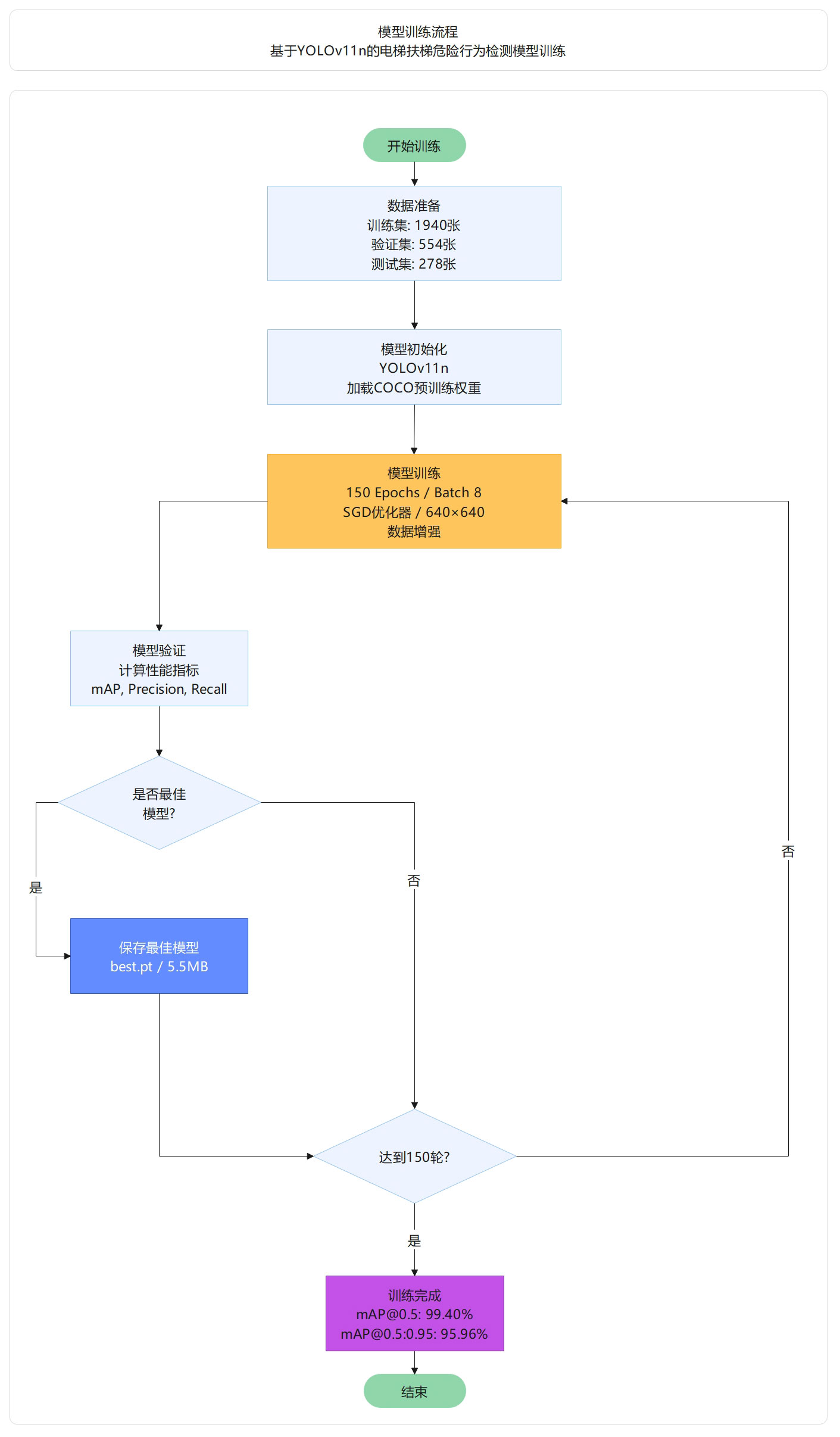

数据集与训练

本章介绍了电梯扶梯危险行为检测数据集的构建过程、模型训练流程与配置,以及YOLOv11n基线模型在验证集上达到99.40%的mAP@0.5和95.96%的mAP@0.5:0.95的检测性能。数据集包含2,772张高质量标注图像(训练集1,940张、验证集554张、测试集278张),涵盖10个危险行为类别(扶梯逆行、扶梯摔倒、攀爬扶手、轮椅上扶梯、携带行李箱、婴儿车上扶梯、衣服卷入扶梯、手伸出扶梯外侧、头伸出扶梯外侧、鞋子卷入扶梯),经过150轮充分训练,模型精确率达99.40%、召回率达99.50%,展现出可靠的检测能力和实用价值。

数据集构建

本研究使用的是电梯扶梯危险行为检测数据集,该数据集专门针对扶梯场景中乘客的不同危险行为进行标注。数据集包含商场、地铁站、机场等多种扶梯场景下的图像,涵盖不同光照条件、不同拍摄角度和客流密度,包含10个危险行为类别(扶梯逆行、扶梯摔倒、攀爬扶手、轮椅上扶梯、携带行李箱、婴儿车上扶梯、衣服卷入扶梯、手伸出扶梯外侧、头伸出扶梯外侧、鞋子卷入扶梯),具有较强的场景多样性和实用价值。数据集共包含2,772张高质量标注图像(3,168个标注框),按照约7:2:1的比例划分为训练集(1,940张)、验证集(554张)和测试集(278张),为模型训练和评估提供了充足的数据支撑。

图43 数据集划分及类别信息统计示意图

数据集特点:

数据集涵盖电梯扶梯场景,包含不同光照、角度和客流密度条件下的十类危险行为标注,共2,772张图像(3,168个标注框)。

数据集划分:

数据集按照约 70:20:10 的比例划分为训练集、验证集和测试集:

表1 数据集划分及用途说明

训练集用于模型的参数学习和特征提取能力训练。验证集用于训练过程中的性能监控和超参数调优,帮助选择最优模型。测试集用于最终的性能评估,确保模型在未见过的数据上具有良好的泛化能力。

图44 数据集在训练、验证和测试集上的分布

数据集质量保证:

为了确保实验数据的可靠性和有效性,本研究的数据集经过严格的质量控制。所有图像均无损坏或无效背景,保证了数据的完整性。标注工作经过多轮人工审核,确保边界框定位精确,类别标注一致且符合定义标准。这些措施有效提升了数据集的质量,为模型训练和性能评估提供了可靠保障。

训练流程

模型训练采用端到端的方式,首先加载训练集和验证集进行数据预处理,然后加载YOLOv11预训练权重进行模型初始化,接着使用SGD优化器进行150轮迭代训练,每轮训练后在验证集上评估性能指标,系统自动保存验证集上性能最佳的模型权重,最终输出完整的性能指标和训练曲线。

图45 模型训练流程

训练流程:

1. 开始训练 → 加载训练集和验证集进行数据预处理

2. 模型初始化 → 加载YOLOv11预训练权重(yolo11n.pt),使用标准YOLOv11架构

3. 模型训练 → 使用SGD优化器进行150轮迭代训练,应用数据增强技术

4. 模型验证 → 每轮训练后在验证集上评估性能指标(Precision, Recall, mAP@0.5, mAP@0.5:0.95)

5. 最佳模型保存 → 系统自动监控验证性能,保存验证集上性能最佳的模型权重(best.pt)

6. 训练完成 → 输出完整的性能指标报告和训练曲线图

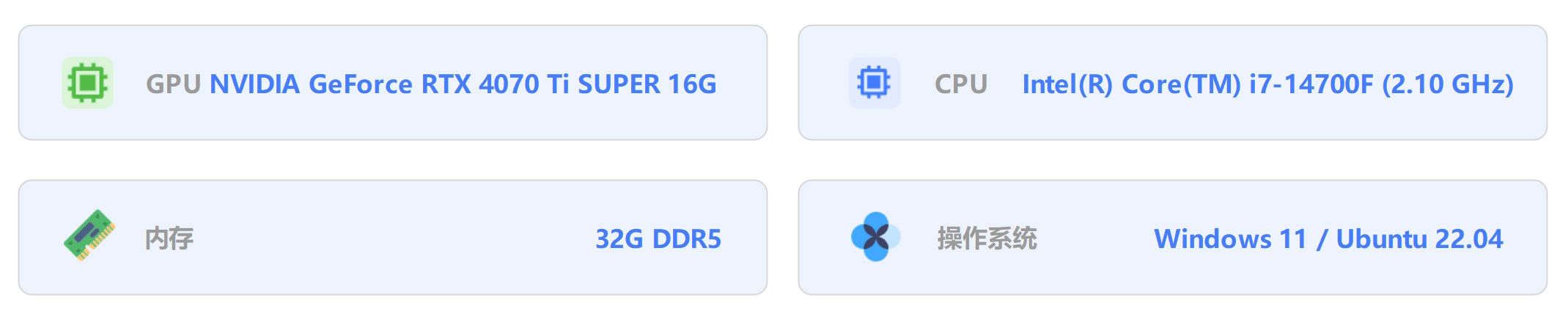

训练配置

硬件环境:

软件环境

训练超参数

数据增强策略

为提高模型泛化能力,训练过程中采用以下数据增强方法:Mosaic增强将4张图像拼接成一张以增加小目标检测能力;随机翻转以50%的概率对图像进行水平翻转;随机缩放在0.5-1.5倍范围内调整图像尺寸;色彩抖动在HSV色彩空间进行随机调整,其中色调(Hue)调整范围为±0.015、饱和度(Saturation)为±0.7、明度(Value)为±0.4;随机平移在±10%范围内对图像进行位置偏移。

图46 数据集图像增强方法

学习率调度策略

学习率调度策略采用线性衰减方式,前3个epoch进行warmup预热,学习率从0线性增长到初始学习率0.01,之后按线性方式从0.01逐步衰减到最终学习率0.0001。

训练结果

性能指标:

经过150轮训练,YOLO11n基线模型在电梯扶梯危险行为检测验证集上取得了优异的性能:

训练曲线分析:

下图展示了模型在150轮训练过程中的完整性能变化,包括损失函数曲线和精度指标曲线:

图47 训练曲线分析

图中展示了10个关键指标的训练过程:训练损失(box/cls/dfl)、验证损失(box/cls/dfl)、精确率、召回率、mAP@50和mAP@50-95

(1)损失函数曲线

从训练曲线图可以看出,训练过程中损失函数呈现稳定下降趋势:训练集边界框损失(train/box_loss)从初始的约1.44快速下降,在第50轮降至约0.73,最终稳定在约0.30;训练集分类损失(train/cls_loss)从初始的约4.35快速下降至约0.52,最终降至约0.21,表明分类准确率持续提高;训练集DFL损失(train/dfl_loss)从约1.39稳步降低至约0.80。验证集损失方面,val/box_loss从1.28下降至约0.31,val/cls_loss从3.58下降至约0.21,val/dfl_loss从1.30下降至约0.82,均与训练集走势一致,曲线平滑,表明模型泛化能力良好,无明显过拟合。

(2)精度指标曲线

Precision曲线从初始的约24%快速上升,最终稳定在99%以上,best.pt验证值为99.40%;Recall曲线从初始的约16%快速上升,最终稳定在99%以上,验证值达到99.50%;mAP@50曲线从初始的约13%快速上升,最终稳定在99.40%;mAP@50-95曲线从初始的8.85%持续上升,经历快速上升阶段(1-30轮,提升至78.61%)、稳定提升阶段(30-90轮,提升至90.51%)和收敛稳定阶段(90-150轮),最终达到96.00%。

(3)Precision-Recall 曲线

图48 Precision-Recall 曲线

展示模型在不同置信度阈值下的精确率和召回率关系,all classes mAP@0.5达到0.995

(4)混淆矩阵(归一化)

图49 归一化混淆矩阵

归一化混淆矩阵展示模型的分类准确性

最佳模型选择

训练过程中,系统自动保存验证集上性能最佳的模型,最佳模型出现在第150轮(mAP@50-95达到峰值95.96%),保存路径为runs/train/yolo11/weights/best.pt,选择标准为验证集mAP@50:0.95指标最高。

训练稳定性分析

- 收敛速度:前30轮快速收敛(8.85%→78.61%),30-90轮稳定提升,90轮后收敛

- 过拟合控制:训练集与验证集损失走势一致,无过拟合

- 训练稳定性:损失曲线平滑,学习率逐步衰减,训练稳定

- 最终状态:最佳模型第150轮,mAP@50-95达96.00

项目资源

我们提供项目的完整技术资源,包括源代码、训练脚本、配置文件、数据集和模型权重等全部内容。代码采用模块化设计,结构清晰,注释完善,支持完全复现论文中的所有实验结果。项目提供详细的文件清单和技术架构说明(网页已经提供),帮助用户快速理解项目结构,便于二次开发和功能扩展。所有资源均已开源,遵循AGPL-3.0协议,用户可自由使用、修改和分发。

关于项目

原创论文

原创论文:基于深度学习电梯扶梯危险行为检测系统的设计与实现 注意:需要另外付费购买!

作者信息

作者:Bob (张家梁)

项目编号:YOLO_6 & Datasets-5

原创声明:本项目为原创作品

开源协议

本项目采用AGPL-3.0开源协议,允许个人和组织自由使用、修改和分发代码,但基于本项目的衍生作品必须同样开源,且用于提供网络服务时需向用户提供完整源代码。本项目仅供学习研究使用,作者不对使用本项目产生的任何后果承担责任,使用者应遵守当地法律法规,合理合法使用本项目。如本项目对您的研究或工作有所帮助,欢迎引用并注明出处。

评论(0)