摘要:随着阿尔茨海默病(Alzheimer’s Disease, AD)对全球老年人群体健康构成日益严峻的挑战,早期诊断显得尤为重要。本文提出了一种基于 Swin-Transformer 的阿尔茨海默病早期影像诊断系统,旨在利用医学影像数据(如脑MRI图像)对患者的认知状态进行分类,从而实现对轻度认知障碍(MCI)和其他认知障碍的精准识别。

项目信息

编号:PCV-8

数据集:Dataset-8

大小:199M

作者:Bob(原创)

环境配置

开发工具:

– PyCharm的安装包:PyCharm: Python IDE for Professional Developers

– PyCharm的历史安装包:PyCharm: Python IDE for Professional Developers

– Anaconda的安装包:Anaconda | Start Coding Immediately

语言环境:Python == 3.12.0

依赖包:

– pip install numpy==2.3.3

– pip install opencv-python==4.12.0.88

– pip install pillow==11.3.0

– pip install PyQt==5.15.11

– pip install torch==2.7.0+cu118

– pip install torchvision== 0.22.0+cu118

– pip install matplotlib==3.10.7

研究背景

阿尔茨海默病(Alzheimer’s Disease, AD)是一种进行性神经退行性疾病,主要表现为记忆丧失、认知功能障碍以及行为和情绪改变。随着全球人口老龄化的加剧,阿尔茨海默病的患病率逐年上升,成为全球范围内影响老年人群体健康的重大公共卫生问题。根据世界卫生组织(WHO)的数据,阿尔茨海默病已成为全球第四大致死原因。早期诊断是有效干预和延缓病情进展的关键,而现有的传统诊断方法往往依赖于临床症状的出现和神经心理学评估,这导致阿尔茨海默病的早期诊断存在较大延误。

随着影像学技术(如磁共振成像MRI)在医学领域的广泛应用,基于影像数据的早期诊断方法得到了迅速发展。MRI影像可以帮助医生观察到脑部的结构性变化,尤其是在阿尔茨海默病患者的大脑中,海马区和内嗅皮层的萎缩是早期的标志性病变。然而,传统的影像分析方法依赖于人工提取特征,并且诊断过程繁琐,容易受到主观因素影响,导致准确性和一致性存在一定问题。

近年来,深度学习和卷积神经网络(CNN)在图像识别领域取得了显著进展,特别是在医学影像分析中,深度学习技术展现了强大的自动化特征提取和分类能力。Swin-Transformer,作为一种新的视觉变换模型,通过自注意力机制和位移窗口技术,能够有效捕捉图像中的细节信息并提高计算效率。因此,基于 Swin-Transformer 的影像诊断方法在处理医学影像时,具有较高的精度和鲁棒性,成为阿尔茨海默病早期诊断的新兴研究方向。

本文旨在提出一种基于 Swin-Transformer 的阿尔茨海默病早期影像诊断系统,利用脑MRI图像对患者进行自动化分类,识别轻度认知障碍(MCI)、极轻度认知障碍、无认知障碍和中度认知障碍等不同认知状态,从而为阿尔茨海默病的早期诊断和干预提供强有力的支持。

算法概述

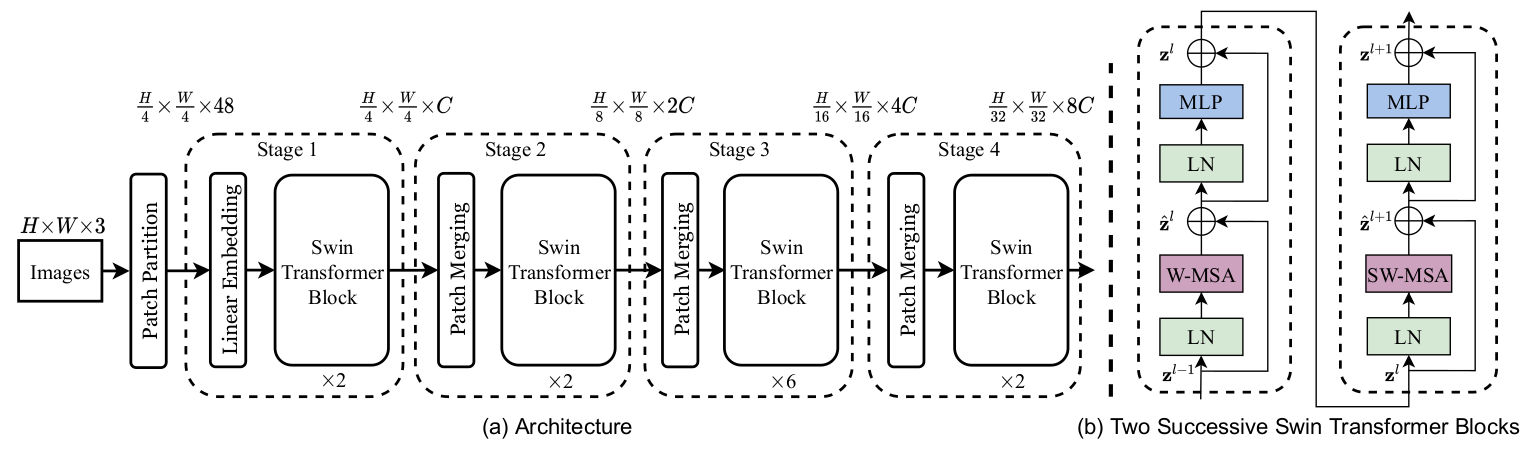

1.Swin Transformer

Swin Transformer由微软公司的研究人员推出,是一种有效结合了 CNN 和 Transformer模型优势的新型架构。它旨在以类似 CNN 的分层方式处理图像,同时利用变换器固有的自我关注机制。这种混合方法使 Swin 变换器能够有效处理各种规模的视觉信息,从而使其在广泛的视觉任务中具有高度的通用性和强大的功能。

Swin Transformer 的核心创新在于其分层结构和基于移位窗口的自我注意力机制。与标准视觉转换器(ViT)在整个图像中应用自我注意力不同,Swin Transformer将图像划分为不重叠的小窗口,在这些窗口内计算自我注意力,从而减少了计算复杂性。此外,Swin Transformer引入了窗口移位技术,使得在连续的Transformer块之间,图像区域能在不同层之间相互影响,从而更好地整合局部与全局上下文信息。

图1 Swin Transformer多层级表示和ViT对比

如图1所示,Swin Transformer从小的patch开始,通过在深层次逐步合并相邻patch的方式构建了一个层级化的表示。通过这些层级特征图,Swin Transformer可以像FPN和U-Net那样进行多尺度密集预测。通过对图像分区(用红色标出)进行非重叠窗口的局部自注意力计算实现了线性的计算复杂度。每个窗口的patch的个数是固定的,因此计算复杂度和图像的大小成线性关系。

相比于之前只能产生单一分辨率特征图和平方复杂度的Transformer模型,Swin Transformer适合作为各种视觉任务的通用主干网络(backbone)。

图2:Swin Transformer网络架构

该架构详细展示了 Swin-Transformer 模型如何通过逐层处理和 Patch Merging 实现高效的图像特征提取。每个阶段的 Swin Transformer Block 通过不同的自注意力机制(如 W-MSA 和 SW-MSA)逐步提升图像理解的深度。通过多层次的处理和特征合并,该模型在处理大规模图像数据时表现出色,特别适合于图像分类和目标检测等任务。

Swin Transformer解决了以往基于 CNN 和 Transformer的模型的几个局限性。首先,它的分层设计可以高效处理多种分辨率的图像,有助于完成需要同时了解精细细节和整体结构的任务,如物体检测和语义分割。其次,通过将自我关注机制定位到窗口并采用移位窗口,Swin Transformer 大幅降低了计算要求,使其更易于扩展到大型图像和数据集。最后,它的架构通过将局部特征无缝集成到更广泛的上下文中,实现了更好的特征学习,从而提高了各种视觉任务的性能。

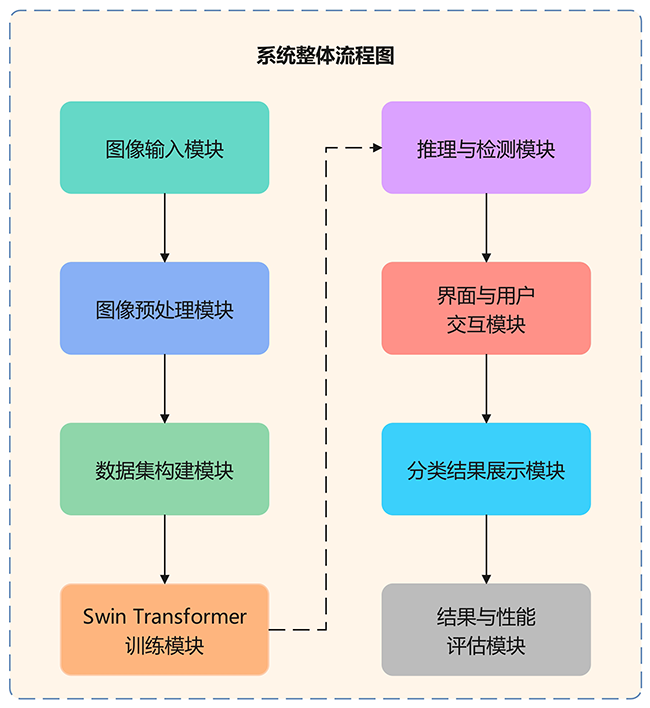

系统设计

本系统旨在实现认知障碍的自动化分析与分类,采用“数据输入 + 模型推理 + 结果展示”的一体化工作流程。系统架构包括图像输入模块、图像预处理模块、数据集准备模块、Swin-Transformer训练模块、推理与检测模块、用户交互界面模块、检测结果展示模块以及实验结果与性能评估模块。通过图形用户界面(GUI),前端界面支持用户便捷地导入认知障碍相关数据并进行交互操作,而后端则通过Swin-Transformer模型进行实时的认知障碍行为分析与分类。Swin-Transformer模型在认知障碍分类任务中表现出色,具有较高的准确性和效率,能够精准区分“轻度认知障碍”、“中度认知障碍”、“无认知障碍”和“极轻度认知障碍”四种认知障碍状态。因此,本系统在医疗健康监测和认知障碍早期诊断领域具有广泛的应用潜力。

图3 诊断系统整体流程图

通过对阿尔茨海默病影像数据集的训练和优化,基于Swin Transformer的模型能够在实时分类中展现出高效性与准确性。特别是在阿尔茨海默病早期诊断的应用中,模型能够精确地区分“轻度认知障碍”、“中度认知障碍”、“无认知障碍”和“极轻度认知障碍”四种认知障碍状态。该系统在实时影像诊断和临床分析中具有广泛的应用前景,为早期干预、个性化治疗以及临床决策提供了强有力的支持。

数据集构建

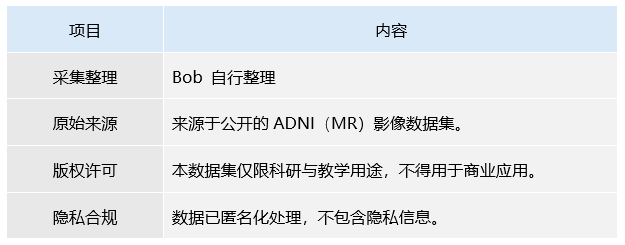

1.数据来源

本系统使用的阿尔茨海默病影像数据主要来源于ADNI(Alzheimer’s Disease Neuroimaging Initiative)数据库。ADNI是全球最广泛使用的阿尔茨海默病相关MRI影像数据集,包含了健康对照组(NC)、轻度认知障碍(MCI)和阿尔茨海默病(AD)患者的MRI影像数据。该数据集提供了多时间点的扫描(纵向数据),使其成为训练和评估认知障碍分级模型的重要资源。通过整理和筛选ADNI数据库中的影像数据,本系统构建了一个多样化的认知障碍影像数据集,涵盖了不同认知障碍状态的影像特征,包括轻度、中度、极轻度认知障碍以及无认知障碍状态。这些数据不仅为阿尔茨海默病的早期诊断提供了高质量的训练数据,也推动了深度学习和人工智能技术在认知障碍检测中的应用,进一步推动了医学影像智能化诊断的进程。

表2 数据集基本信息

该数据集包括“轻度认知障碍”、“中度认知障碍”、“无认知障碍”和“极轻度认知障碍”等不同认知障碍状态的脑部影像。数据集不仅涵盖了多种认知障碍类型,且具有较高的质量,适用于系统的认知障碍行为分类任务,为阿尔茨海默病及其他认知障碍的自动化诊断提供了高质量的训练数据。该数据集旨在推动深度学习和人工智能技术在医学影像分析领域中的应用,特别是在认知障碍检测中,提供强有力的数据支持,旨在提高认知障碍诊断的准确性和效率。

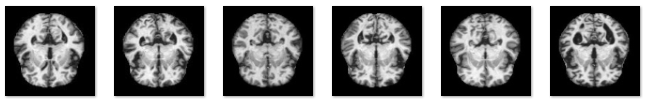

图4 数据集图片

本研究在对原始阿尔茨海默病影像数据进行清洗与筛选后,构建了一个包含四种认知障碍状态的认知障碍行为数据集,分别为“轻度认知障碍”、“中度认知障碍”、“无认知障碍”和“极轻度认知障碍”。该数据集的类别分布均衡,全面涵盖了阿尔茨海默病及其他认知障碍状态,能够真实反映不同认知障碍状态下的脑部影像特征。数据集中每类认知障碍状态的影像均经过标准化处理与质量控制,确保了样本的代表性与清晰度。该数据集为后续基于深度学习模型进行认知障碍行为识别与分类提供了坚实的数据支撑,为医学影像分析领域的智能化与自动化研究奠定了基础。

2.分类方法

本系统所使用的阿尔茨海默病影像数据的分类信息由专业人员完成。每个脑部影像都被分配到一个明确的认知障碍状态,如“轻度认知障碍”、“中度认知障碍”、“无认知障碍”和“极轻度认知障碍”。为确保分类的准确性和可靠性,分类过程由专业人员独立完成,并通过交叉验证的方式进行审核,从而有效降低个体差异带来的偏差,确保数据分类的一致性和权威性。该分类方法确保了数据集的高质量,并为后续基于深度学习模型的认知障碍行为分类模型训练提供了坚实的数据支持。

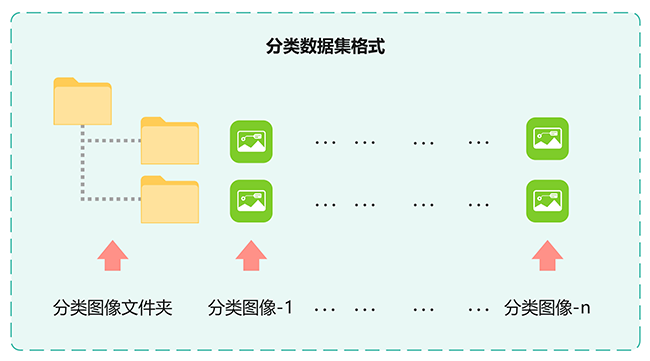

(1)分类数据集格式

该格式主要用于图像分类任务,常见于Swin Transformer等深度学习模型的训练。其方法是将每张图像归类为一个明确的类别。该格式能够确保数据与模型在训练与推理过程中的高效匹配,从而提高分类精度和推理效率。Swin Transformer通过其分层结构和移位窗口自注意力机制,能够更好地处理图像中的局部与全局上下文信息,进一步提升了分类性能。这种格式简化了数据准备过程,并为基于Swin Transformer的图像分类模型训练提供了高效且标准化的数据输入。

图5 分类数据集格式

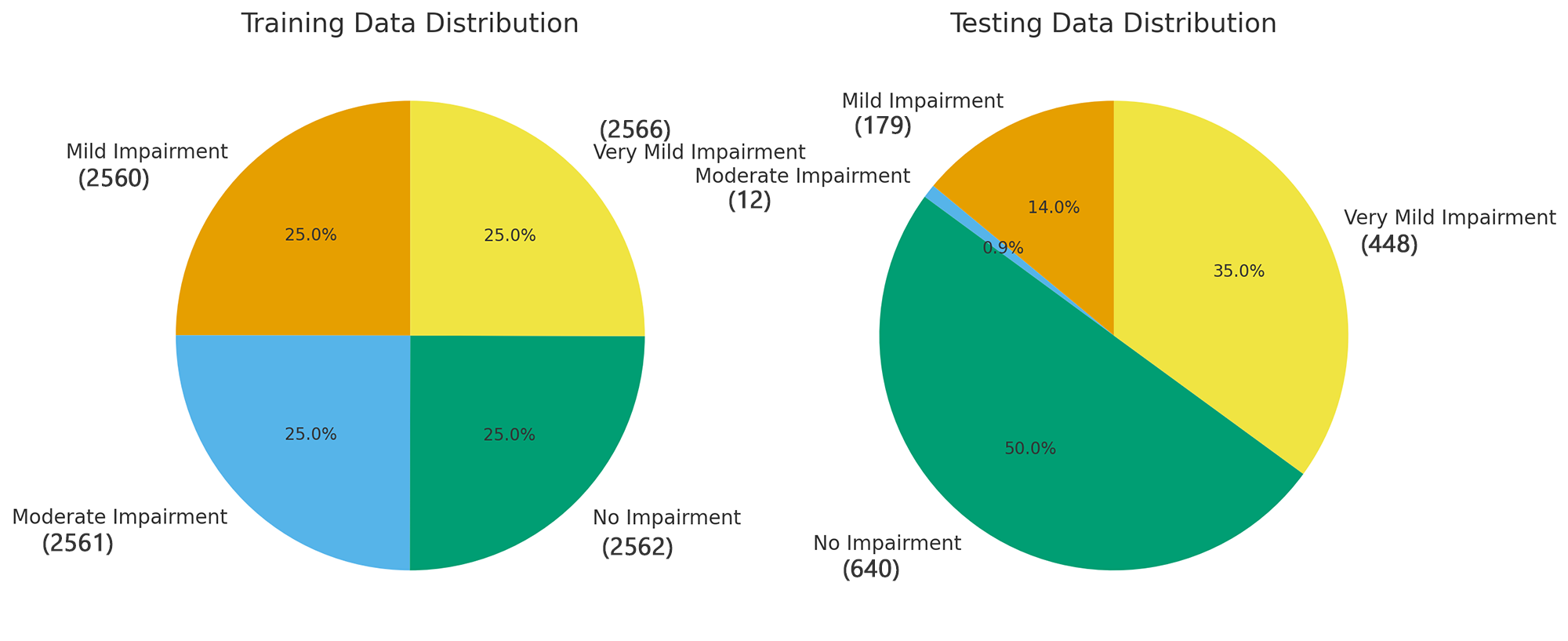

(2)数据集划分

标注后的数据集不仅包括图像文件,还包含对应的分类信息。经过上述所有步骤处理和验证后的图像数据被划分成训练集和测试集,形成最终的数据集,用于算法训练学习模型。

图6 数据集划分:测试集和训练集

以下是数据集的具体含义及每个数据集的作用:

表3 数据集概述

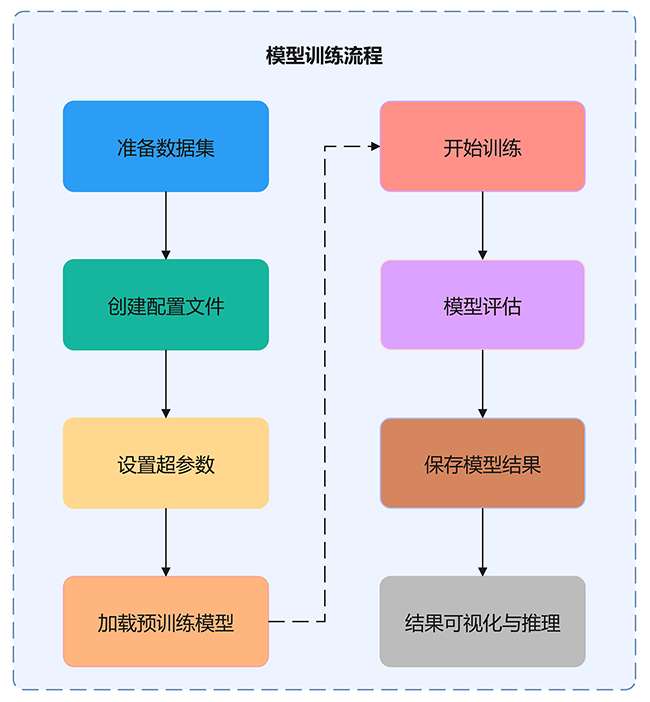

模型训练

Swin Transformer 是一种常用于图像分类任务的深度学习模型。其训练过程主要包括以下几个步骤:配置文件与超参数的设置、训练过程的执行以及训练结果的可视化分析。Swin Transformer通过其分层结构和移位窗口自注意力机制,能够有效处理图像中的局部与全局上下文信息,进一步提升分类精度和效率。在训练过程中,Swin Transformer能够通过高效的计算方式应对大规模数据集,并且在多个图像分类任务中展现出了优异的性能。

图7 模型训练流程图

1.配置文件与超参数设置

以下是关于Swin Transformer模型训练过程中的配置文件和超参数设置,并通过配置文件以及相关参数进行训练设置。

表4 Swin Transformer模型训练超参数设置

2.模型性能评估

在 Swin Transformer模型的训练过程中,模型性能评估是衡量其在图像分类任务中表现的重要环节,能够全面反映模型在分类精度和泛化能力方面的表现。科学而准确的评估不仅有助于揭示模型的优势与不足,还能为后续的改进与优化提供可靠依据。

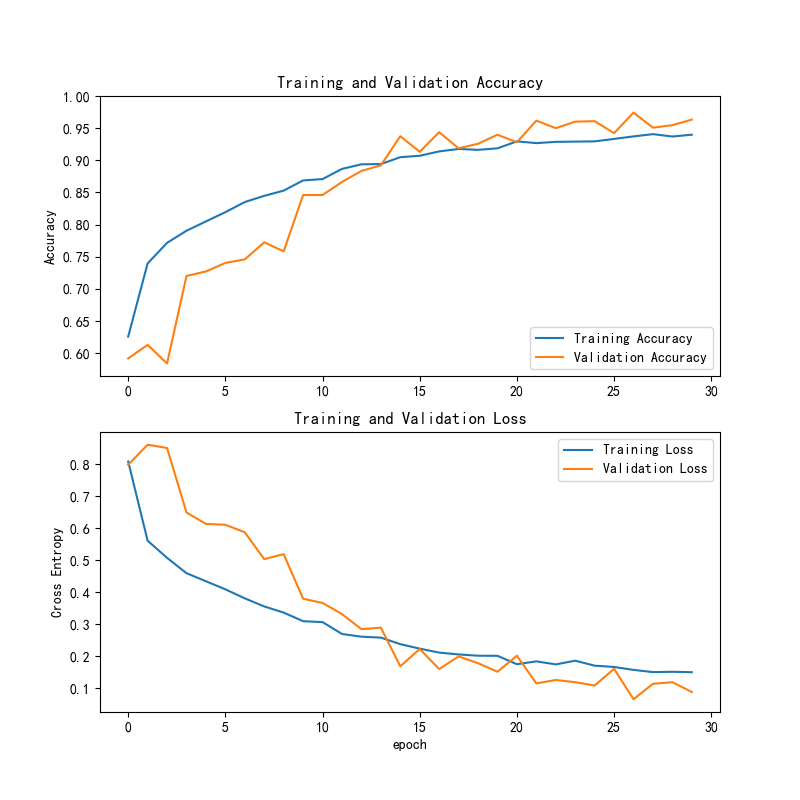

(1)训练与验证准确率和损失曲线

图8 Swin Transformer训练与验证准确率和损失曲线

该图展示了模型在训练过程中训练和验证准确率以及损失的变化趋势。在训练阶段,训练准确率稳步上升,最终趋于稳定,表明模型在训练集上逐渐学习并优化特征。与之相对,验证准确率虽然也呈上升趋势,但波动较大,尤其在训练初期,表现出较差的泛化能力,可能表明模型出现了过拟合。损失方面,训练损失随着训练的进行持续下降,验证损失则在初期较高,随着训练的深入逐步减小,但整体波动较大,进一步证明了过拟合的可能性。总体而言,模型在训练集上表现较好,而在验证集上的波动较大,提示需要采取措施改善验证集的表现,如使用正则化技术以提高模型的泛化能力。

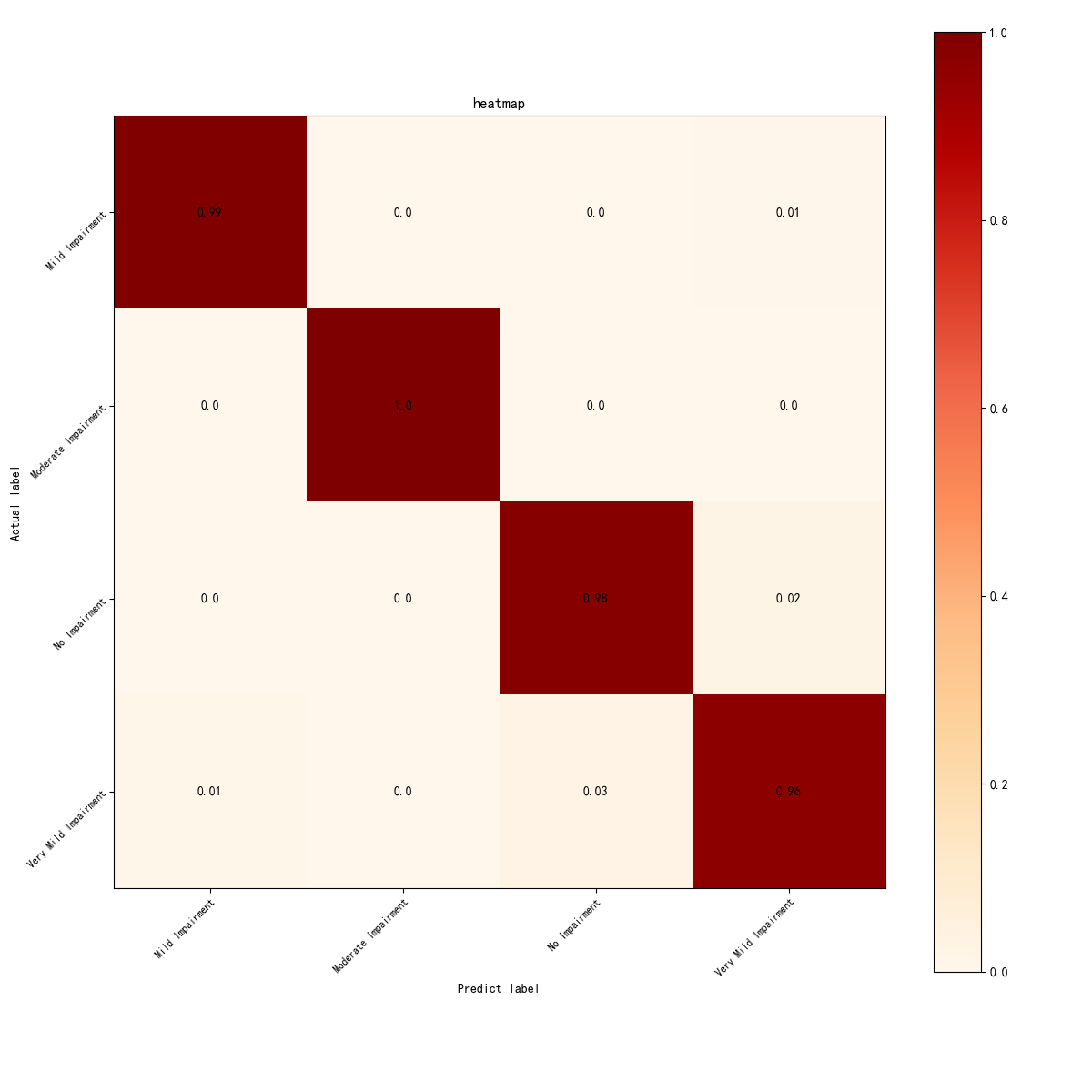

(2)混淆矩阵热力图

图9 Swin Transformer混淆矩阵热力图

该热力图展示了模型在不同认知障碍状态下的混淆矩阵。矩阵中的数值代表了实际标签和预测标签之间的匹配程度,数值越大,模型预测越准确。例如,在“轻度认知障碍”类别中,模型正确预测了99%的样本,而在“无认知障碍”类别中,模型正确预测了98%的样本。整体而言,模型在四个类别中的表现都非常好,特别是在“中度认知障碍”和“无认知障碍”类别上,几乎达到了100%的准确率。这表明模型在这些类别上的泛化能力较强,误分类率较低。只有在“极轻度认知障碍”类别中,模型出现了少量的误分类。总体而言,热力图显示出模型在识别不同认知障碍状态时具有较高的准确性和良好的表现。

(3)各类的分类性能评估:准确率、精确率、召回率与F1分数图

图9 各类认知障碍的分类性能评估:准确率、精确率、召回率与F1分数图

该图展示了模型在各类认知障碍状态下的性能评估,包括准确率、精确率、召回率和F1分数。从图中可以看出,模型在四个类别中的表现都非常优秀,准确率达到97%。在精确率、召回率和F1分数上,所有类别均接近1,尤其在“中度认知障碍”类别中表现完美,达到100%。其他类别如“轻度认知障碍”和“无认知障碍”也显示出非常高的预测性能,精确率和召回率均在0.98以上,F1分数为0.98,表明模型不仅能够准确地识别不同类别,还具备较强的召回能力,确保了对各类认知障碍的高效检测。整体而言,模型在认知障碍的分类任务中展现了卓越的性能,具有良好的泛化能力和实际应用价值。

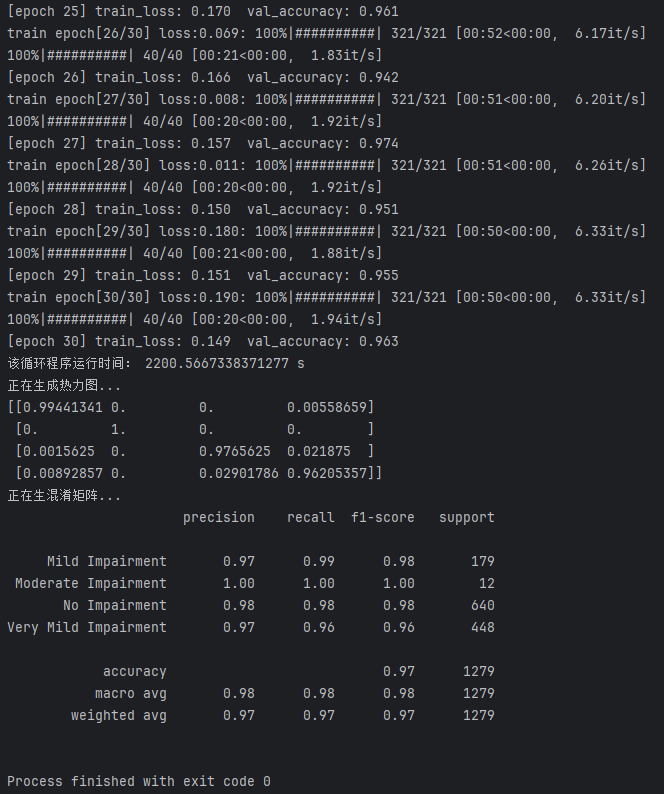

(4)训练日志(Training Log)

训练日志记录了Swin Transformer模型在训练过程中的详细信息,包括训练轮次、每轮的损失值、验证准确率以及训练时间等,这些信息帮助评估模型的训练效果和性能。

图10 Swin Transformer训练日志

图11 模型训练日志概要

功能展示

本系统基于深度学习的Swin Transformer模型,旨在实现阿尔茨海默病早期影像的自动诊断与分类。系统集成了Swin Transformer模型,用于对阿尔茨海默病影像进行特征提取、分类及诊断结果展示。通过对比不同模型的性能表现,本系统为阿尔茨海默病早期诊断的智能化、标准化研究提供了技术支撑。以下为主要功能界面的展示:

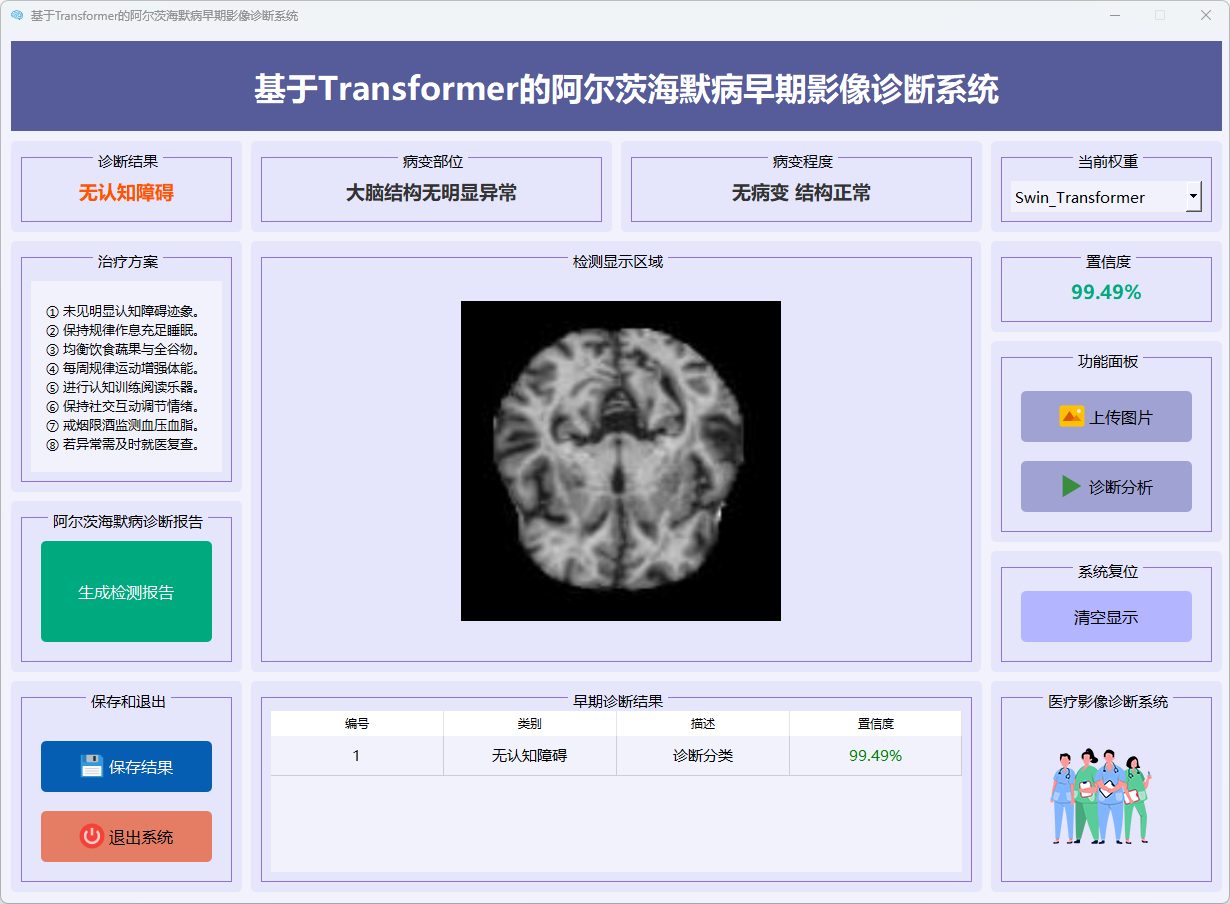

1. 系统主界面展示

系统主界面集成了阿尔茨海默病影像上传、模型选择、实时分析及诊断结果展示等功能。用户可在界面中直观选择不同的深度学习模型(如Swin Transformer),上传阿尔茨海默病影像后,系统将自动进行特征提取与分类分析,并生成对应的诊断结果。界面支持对模型预测结果的可视化展示,方便科研人员和临床医生对比不同模型在阿尔茨海默病早期诊断中的性能表现。

图12 系统主界面

2. 图片检测功能

系统支持对阿尔茨海默病影像进行快速诊断。用户可以上传阿尔茨海默病影像样本,系统会自动进行分析,识别认知障碍的类型,并给出诊断结果、分类标签和置信度评分。诊断结果通过清晰的文本和图表直观呈现,帮助科研人员和临床医生快速评估不同模型(如Swin Transformer)在阿尔茨海默病早期诊断中的性能表现,从而为进一步的医疗决策提供支持。

图13 极轻度认知障碍

图14 轻度认知障碍

图15 无认知障碍

图16 中度认知障碍

3. 保存结果

图17 结果保存

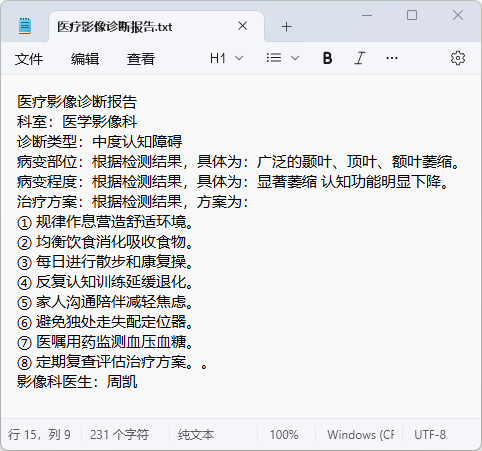

4. 生成医疗影像诊断报告

图18 成功生成医疗影像诊断报告

图19 诊断报告

界面设计

本系统的图形用户界面采用PyQt5框架开发,致力于打造直观、高效且流畅的交互体验。通过精心设计的界面布局和模块化架构,系统功能得以清晰呈现,并确保各项操作的高效执行,全面提升用户使用体验。

图20 PyQt5主控面板界面

该界面展示了基于PyQt5框架精心设计的阿尔茨海默病早期影像诊断系统,界面布局简洁、直观且高度集成。通过巧妙的模块化设计,系统涵盖了多项功能模块,确保用户能够高效、流畅地进行操作与交互,充分体现了系统在医学领域中的智能化与人性化设计。

文件清单

1.核心文件

2.训练文件

3.训练模型

4.界面文件

5.数据集文件

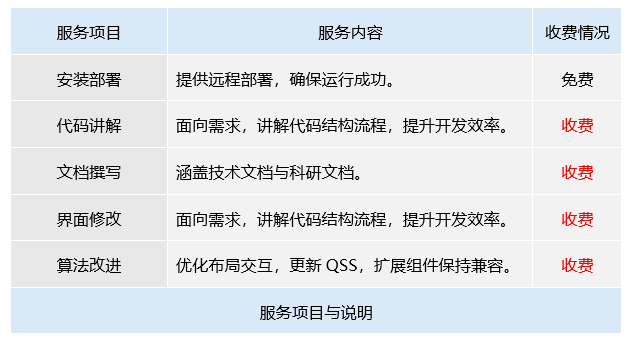

服务项目

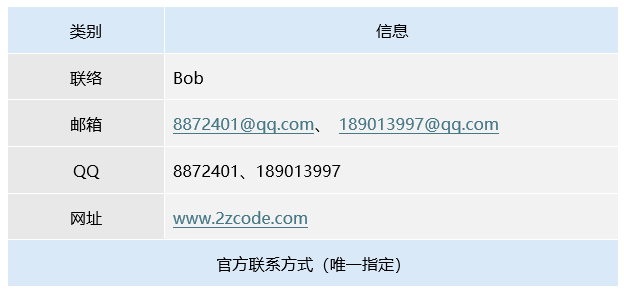

联系我们

官方声明

(1)实验环境真实性与合规性声明:

本研究所使用的硬件与软件环境均为真实可复现的配置,未采用虚构实验平台或虚拟模拟环境。实验平台为作者自主购买的外星人笔记本(Alienware)笔记本,具体硬件参数详见表。软件环境涵盖操作系统、开发工具、深度学习框架等,具体配置详见表,所有软件组件均来源于官方渠道或开源社区,并按照其许可协议合法安装与使用。

研究过程中严格遵循学术诚信和实验可复现性要求,确保所有实验数据、训练过程与结果均可在相同环境下被重复验证,符合科研规范与工程实践标准。

(2)版权声明:

本算法改进中涉及的文字、图片、表格、程序代码及实验数据,除特别注明外,均由2zcode.Bob独立完成。未经2zcode官方书面许可,任何单位或个人不得擅自复制、传播、修改、转发或用于商业用途。如需引用本研究内容,请遵循学术规范,注明出处,并不得歪曲或误用相关结论。

本研究所使用的第三方开源工具、框架及数据资源均已在文中明确标注,并严格遵守其相应的开源许可协议。使用过程中无违反知识产权相关法规,且全部用于非商业性学术研究用途。

评论(0)